画像生成AIを使っていて、「もっと速く画像が出てくればいいのに!」とイライラしたことはありませんか?

高画質なイラストを作ろうとすると、どうしても生成に時間がかかってしまいがちですよね。

「PCのスペックが低いから仕方ない…」と諦めている方も多いのですが、実は設定を見直したり、最新の高速化技術を取り入れたりするだけで、劇的に改善するケースがたくさんあるんです。

現在、Stable Diffusionの世界では「LCM」や「WebUI Forge」といった新しい技術が次々と登場しており、以前とは比べものにならないほど快適な生成が可能になっています。

今回は、初心者の方でもすぐに実践できる基本的な設定から、グラフィックボード(グラボ)の選び方、そしてMacユーザー向けの対策まで、幅広く解説していきます。

難しい専門用語もできるだけ噛み砕いて説明しますので、ぜひ最後まで読んでみてくださいね。

読み終わる頃には、あなたの画像生成環境が驚くほど快適になっているはずですよ。

- PCのスペックを変えずに今すぐ試せる高速化設定

- 2026年の主流となる「WebUI Forge」や「LCM」の活用法

- WindowsとMacそれぞれに適した最適な環境構築

- 生成速度と画質のバランスを保つための具体的なコツ

Stable Diffusionの生成速度を上げるための設定と基本テクニック

「生成ボタンを押してから、完了するまでが長い…」

そう感じたら、まずは手元の設定や環境を見直してみましょう。

新しいパーツを買わなくても、ソフトウェア側の工夫だけでStable Diffusionの生成速度を上げることは十分に可能です。

ここでは、初心者の方でもすぐに試せる具体的な方法をいくつかご紹介します。

なぜ急にStable Diffusionの生成速度が遅くなったのか?

「前はもっと速かった気がするのに…」と感じているなら、いくつかの原因が考えられます。

最もよくあるのが、VRAM(ビデオメモリ)の不足です。

高解像度の画像を生成したり、「ControlNet」などの便利な拡張機能をたくさん入れたりすると、グラボのメモリが足りなくなり、PC本体のメインメモリを使おうとします。

この切り替えが発生すると、処理速度はガクンと落ちてしまいます。

また、ブラウザでYouTubeを開きっぱなしにしていたり、他の重いソフトを起動していたりしませんか?

バックグラウンドで動いているアプリを閉じるだけでも、リソースが確保されて改善することがありますよ。

まずはタスクマネージャーなどを確認して、何がメモリを食っているのかチェックしてみましょう。

初心者でも簡単!Stable Diffusionの高速化オプション設定

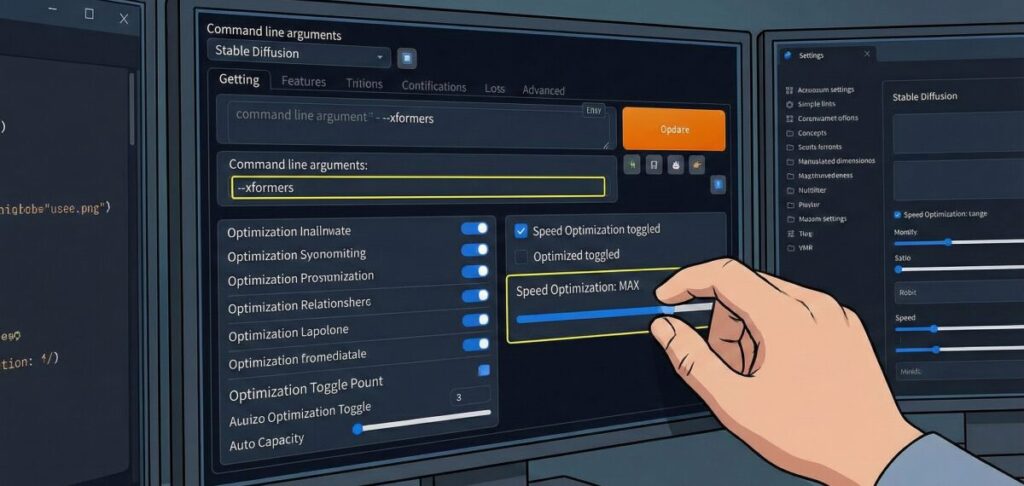

Stable Diffusion(特にAutomatic1111版)には、起動時に読み込ませる「コマンドライン引数」という魔法の言葉があります。

これを設定ファイル(webui-user.bat)に書き加えるだけで、処理がスムーズになるんです。

特に効果的なのが以下のオプションです。

--xformers: NVIDIAのグラボを使っているなら、ほぼ必須と言える高速化・省メモリ化のコマンドです。--opt-sdp-attention: PyTorch 2.0以降を使っている場合、xformersの代わりにこちらを使うとさらに速くなることがあります。

これらは「呪文」のようなものですが、効果は絶大です。

「設定なんて難しそう…」と思うかもしれませんが、これを入れるだけで生成時間が2〜3割短縮されることも珍しくありません。

自分の環境に合わせて、どちらか一つを試してみてくださいね。

2025年の主流?WebUI ForgeやLCMで高速化 2025

2025年現在、従来の「Automatic1111」に代わって注目されているのが、「WebUI Forge」です。

これは、もともとのWebUIをベースにしつつ、内部の処理を最適化したバージョンで、特にVRAMが少ないグラボでもサクサク動くように設計されています。

導入するだけで生成速度が速くなり、エラーも減るので、これから始めるならForgeへの乗り換えを強くおすすめします。

さらに、「LCM(Latent Consistency Models)」や「Hyper-SD」、「Lightning」といった新しいモデル技術も登場しています。

これまでは画像を完成させるのに20〜30ステップ(回数)の計算が必要でしたが、これらの技術を使えば、なんと4〜8ステップで同等の画質が作れてしまうんです。

単純計算で3倍以上のスピードアップになりますから、使わない手はありませんよね。

ステップ数と解像度の見直しでStable Diffusionの生成速度比較

基本的なことですが、生成する画像のサイズやステップ数の設定は適切でしょうか?

Stable Diffusionの生成速度比較をしてみると、設定による違いがよく分かります。

| 設定項目 | 軽い設定(高速) | 重い設定(低速) | おすすめのバランス |

| 画像サイズ | 512×512 | 1024×1024以上 | 512〜768で生成して高画質化 |

| Sampling Steps | 10〜20 | 50以上 | 20〜30(モデルによる) |

| Hires. Fix | オフ | オン(高倍率) | 必要な時だけ1.5倍〜2倍 |

いきなり大きなサイズで生成するのではなく、まずは小さく作って、気に入ったものだけを「Hires. Fix(高画質化)」で大きくする。

この手順を徹底するだけで、無駄な待ち時間を大幅に減らせます。

「とりあえず50ステップ」などと過剰な設定にせず、モデル推奨の数値(最近のアニメ系モデルなら20〜28程度)に合わせるのがコツですよ。

Stable Diffusionの生成速度を上げるハードウェアと高度な活用術

設定を見直しても限界がある…もっと爆速で大量に画像を生成したい!

そんな方は、やはりPCのパーツ(ハードウェア)や、より専門的な技術に目を向ける必要があります。

ここでは、Stable Diffusionの生成速度を上げるための機材選びや、一歩進んだテクニック、そしてスキルを収益化するためのヒントについてお話しします。

Stable Diffusionの高速化に欠かせないNVIDIAグラボの選び方

画像生成AIにおいて、最も重要なパーツは間違いなくグラフィックボード(GPU)です。

そして、Stable Diffusionを快適に動かすなら、事実上NVIDIA製のGeForceシリーズ一択と言っても過言ではありません。

Stable Diffusion高速化 NVIDIAと検索されることが多いのも、AI処理に特化した「CUDAコア」や「Tensorコア」が搭載されているからです。

選ぶ際の基準は、計算速度(チップの性能)よりもVRAM(ビデオメモリ)の容量を重視してください。

- VRAM 8GB: 生成はできますが、学習や高解像度化には工夫が必要。

- VRAM 12GB: コスパ最強のライン(RTX 3060 12GB, RTX 4060 Ti 16GBなど)。初心者から中級者に最適。

- VRAM 16GB以上: 本格的な学習や4K生成も快適。

「RTX 4090」のようなハイエンドモデルなら爆速ですが、価格も高いですよね。

予算に合わせて、少なくともVRAM 12GB以上のモデルを選ぶと、長く快適に使えますよ。

また、さらに速度を追求するなら、NVIDIA専用の高速化技術である「TensorRT」を導入することで、生成速度を最大2倍程度まで引き上げることも可能です。

Macユーザー必見!Stable diffusionの生成速度を上げる mac

「Macしか持っていないけど、諦めたくない!」という方も安心してください。

WindowsのNVIDIA環境に比べると不利な面はありますが、最近のAppleシリコン(M1, M2, M3チップ)は非常に優秀です。

Stable diffusion 生成 速度 上げる macためのポイントは、「Core ML」などの最適化技術を使うことや、Mac向けに特化したアプリ(「Draw Things」や「Mochi Diffusion」など)を活用することです。

WebUIを使う場合も、起動オプションに–no-halfなどを安易に入れると遅くなることがあるので、Mac専用のインストールガイド(Lamasのガイドなど)を参考に、適切な設定を行うことが大切です。

M3 Maxなどの上位チップであれば、WindowsのデスクトップPCに迫る速度を出せることもありますよ。

生成速度だけでなく「実務レベル」のスキルを身につけるには?

ここまで高速化の技術的な話をしてきましたが、環境構築やエラー対応に時間を取られすぎて、肝心の「画像を作る楽しみ」や「クリエイティブな作業」がおろそかになっていませんか?

実は、AI画像生成の世界は技術の進歩が速すぎて、独学ですべてを追いかけるのはかなり大変なんです。

もしあなたが、

- 「設定やエラーとの戦いではなく、もっと自由に作品を作りたい」

- 「ゆくゆくはこのスキルで副業や仕事を獲得したい」

と考えているなら、専門のスクールで体系的に学ぶのも一つの賢い選択肢です。

例えば、バイテック生成AIスクールのような場所では、単なるツールの使い方だけでなく、ControlNetを使った精密な画像生成や、企業案件で求められるクオリティの出し方まで、実務に直結するスキルを教えてくれます。

独学だと数日悩んでしまうようなトラブルも、プロの講師がいれば即座に解決できますし、何より「稼ぐ」ことに特化したカリキュラムが用意されているのが強みです。

高速化で浮いた時間を、こうした「将来につながる学び」に投資してみるのも良いかもしれませんね。

AIを使って副業を始めたいけれど、「独学だと挫折しそう」「本当に案件が取れるか不安」という方は、実務と収益化に特化したスクールを検討してみるのも近道です。

\ ※完全オンライン・スマホで1分で予約完了 /

実際に、未経験から月5万円の収益化を目指せるバイテック生成AIというスクールについて、評判やカリキュラムの実態を詳しく検証してみました。

▼続きはこちらの記事で解説しています

Stable Diffusionの生成速度を上げる方法まとめ

いかがでしたでしょうか。

Stable Diffusionの生成速度は、高価なPCを買わなくても、設定や使うモデルを変えるだけで大きく改善できる可能性があります。

最後に、今回ご紹介したStable Diffusionの生成速度を上げるための重要ポイントをまとめておきます。

これらを一つずつチェックして、快適な画像生成ライフを手に入れてくださいね。

- まずはタスクマネージャーでメモリ不足や不要なアプリを確認する

- 起動オプションに

--xformersや--opt-sdp-attentionを追加する - Automatic1111から、動作が軽い「WebUI Forge」への移行を検討する

- 「LCM」や「Hyper-SD」モデルを活用して、少ないステップ数で生成する

- 最初は低解像度(512pxなど)で生成し、後から高画質化を行う

- ステップ数は必要以上に上げすぎず、20〜30程度を目安にする

- VRAM不足が原因なら、思い切って12GB以上のNVIDIAグラボを検討する

- NVIDIAユーザーなら「TensorRT」の導入でさらなる高速化を目指す

- MacユーザーはM1/M2/M3チップに最適化されたアプリや設定を使う

- ControlNetなどの重い拡張機能は、必要な時だけオンにする

- バッチサイズを調整して、一度に複数枚生成する方が効率が良い場合もある

- プレビュー画面の更新頻度を下げると、わずかだが速度が上がることがある

- ドライバー類(特にGPUドライバー)は常に最新の状態に保つ

- エラー対応や環境構築に疲れ果てる前に、プロに学ぶ選択肢も持つ

- 高速化で浮いた時間は、プロンプトの研究や作品のブラッシュアップに使う

参考資料・引用元

記事内で解説した高速化技術やベンチマークに関する根拠となる一次情報は、以下の通りです。

- NVIDIA Technical Blog: Accelerating Stable Diffusion with NVIDIA TensorRT

- (出典:NVIDIA公式開発者ブログ)

- NVIDIA製GPUにおける画像生成AIの高速化技術「TensorRT」の仕組みと、具体的な速度向上データが示された公式技術ドキュメントです。

- Latent Consistency Models: Synthesizing High-Resolution Images with Few-Step Inference

- (出典:Cornell University / arXiv.org)

- 高速生成技術「LCM」の開発者(清華大学の研究チーム等)による原著論文。数ステップでの画像生成を実現する技術的根拠となる学術資料です。

- PyTorch: Accelerated Generative AI with PyTorch 2.0

- (出典:PyTorch公式ブログ / Meta AI)

- 高速化オプション

--opt-sdp-attentionの基盤となる、PyTorch 2.0のパフォーマンス向上とメモリ最適化に関する公式発表および検証データです。

.jpg)