せっかくStable Diffusionで画像を生成したのに、指の本数が多かったり、手足が変な方向を向いていたりと、「奇形」に悩まされることはありませんか?

「頭の中に描いた理想のイラストをそのまま形にしたいのに、どうしても崩れてしまう…」

そんな風に落ち込んでしまう気持ち、すごくよく分かります。私も最初は、何度生成してもエイリアンのような画像が出てきてしまい、モニターの前で頭を抱えていました。

でも、安心してください。Stable Diffusionの奇形防止には、明確な「コツ」と「設定」が存在します。これらを知っているかどうかで、画像のクオリティは天と地ほど変わってくるのです。

今回は、初心者の方でもすぐに実践できる基本的な対策から、プロが使っている少し高度なテクニックまで、徹底的にわかりやすく解説していきますね。

この記事を読むと、Stable Diffusion奇形防止について以下のことが理解できます。

- 指や手足の崩れを防ぐための「ネガティブプロンプト」の正しい設定方法

- 胴長や顔の崩れを引き起こさないための、適切な解像度と生成手順

- 簡単に入れるだけでクオリティが上がるembeddingやLoRAの活用術

- 分割生成を使って、高画質なまま破綻を防ぐプロのテクニック

Stable Diffusionで奇形防止をする基本テクニック

まずは、誰でもすぐに実践できる基本的な対策から見ていきましょう。

奇形や崩れが発生する原因の多くは、AIに対する指示が曖昧だったり、AIが苦手とする部分を「やらないで」と伝えていなかったりすることにあります。ここでは、プロンプト(呪文)を使った解決策を中心に解説します。

ネガティブプロンプトStable Diffusionで必須の呪文

Stable Diffusionで奇形防止をする上で、最も手軽で効果的なのが「ネガティブプロンプト」の活用です。

これは、「画像に描いてほしくない要素」をAIに伝えるための指示出しのことです。

通常、私たちは「可愛い女の子」「青い空」といった描いてほしいもの(ポジティブプロンプト)ばかりに気を取られがちです。しかし、Stable Diffusionは「何を描かないか」を指定してあげることで、生成画像の精度が劇的に向上します。

例えば、ネガティブプロンプトを入力しない状態だと、AIは「指は5本である」という常識を無視してしまうことがあります。そこで、「指の欠損」や「多すぎる指」を否定する言葉を入れてあげるのです。

これは料理で例えるなら、「美味しいカレーを作って」と注文するだけでなく、「激辛にはしないで」「パクチーは入れないで」と詳しくオーダーするようなものです。こうすることで、より理想に近い結果が得られるようになります。

Stable Diffusionネガティブプロンプトおすすめ一覧

では、実際にどのような言葉を入れればよいのでしょうか? ここでは、Stable Diffusionネガティブプロンプトおすすめの単語を一覧にしました。

これらをそのままコピペして、ネガティブプロンプト欄(Negative Prompt)に入力してみてください。

| 役割 | プロンプト(英語) | 意味 |

| 品質向上 | worst quality, low quality, normal quality, lowres | 低品質、低解像度を排除 |

| 人体構造 | bad anatomy, bad hands, missing fingers, extra digit, fewer digits | 崩れた解剖学、悪い手、指の欠損、多すぎる指 |

| 顔の修正 | ugly face, mutated hands, mutation, deformed | 醜い顔、変形した手、突然変異、奇形 |

| 構図 | blurry, jpeg artifacts, text, watermark, signature | ぼやけ、JPEGノイズ、文字、透かし、署名 |

Stable Diffusionネガティブプロンプト一覧として、これらは基本セットとして毎回入れておくことをおすすめします。

特に「worst quality」や「low quality」を入れるだけでも、全体の書き込み量が増え、結果として細部の破綻が目立たなくなる効果があります。

Stable Diffusion奇形防止embeddingの活用法

ネガティブプロンプトを毎回たくさん入力するのは大変ですよね。そこで便利なのが「Embedding(エンベディング)」という機能です。

これは、「奇形や低品質な要素をまとめて排除するデータ」をあらかじめ読み込ませておく技術です。

代表的なものに「EasyNegative」や「DeepNegative」などがあります。これらを導入すると、ネガティブプロンプトに「EasyNegative」という単語を一つ入れるだけで、数行分のネガティブプロンプトを入力したのと同じ、あるいはそれ以上のStable Diffusion奇形防止効果が得られます。

使い方はとても簡単です。

- Hugging FaceやCivitaiなどのサイトからEmbeddingファイルをダウンロードする。

- Stable Diffusionの「embeddings」フォルダに入れる。

- 生成時にネガティブプロンプト欄でそのファイルを指定する(またはTextual Inversionタブから選択する)。

たったこれだけで、指の描写や全体のバランスが見違えるほど良くなります。もし「まだ導入していない」という方がいれば、真っ先に試してほしいテクニックです。

Stable Diffusionポジティブプロンプトの調整も重要

ここまで「描かないこと」に焦点を当ててきましたが、実はStable Diffusionポジティブプロンプト(描いてほしい指示)の質も、奇形防止に大きく関わってきます。

AIに対して明確なイメージを伝えることができれば、AIも迷わずに描画できるため、崩れが少なくなります。

具体的には、以下の単語をプロンプトの先頭に入れるのが有効です。

- masterpiece(傑作)

- best quality(最高品質)

- ultra detailed(超詳細)

- 8k wallpaper(8K壁紙のような高画質)

これらの「クオリティ系タグ」を入れることで、AIは「これは高品質な絵にする必要があるんだな」と理解し、細部まで丁寧に書き込もうと努力します。

逆に、指示が少なすぎると、AIが勝手に隙間を埋めようとして、予期せぬ物体や奇形を生み出してしまうことがあります。ネガティブプロンプト Stable Diffusionの設定と合わせて、ポジティブ側でもしっかりと品質を担保するようにしましょう。

Stable Diffusion奇形防止の上級編と胴長対策

基本を押さえたところで、ここからは少し踏み込んだ内容に入っていきましょう。

「画像サイズを大きくしたら体が伸びてしまった」「もっと複雑なポーズを綺麗に出したい」といった悩みは、生成に慣れてきた頃に必ずぶつかる壁です。

Stable Diffusion胴長になる原因と高解像度化

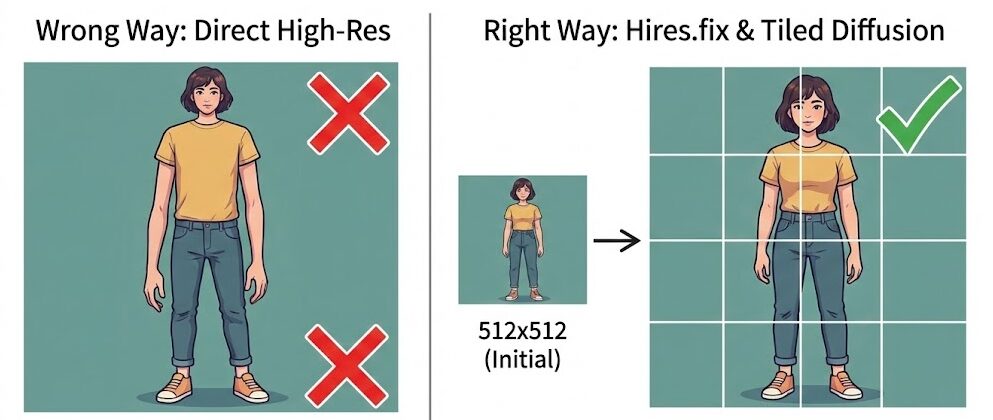

高画質な画像を作ろうとして、最初から「1024×1024」などの大きなサイズで生成していませんか?

実は、これがStable Diffusion胴長になる最大の原因です。

Stable Diffusionの多くのモデル(特にSD1.5系)は、基本的に「512×512」のサイズで学習されています。そのため、一度に大きな画像を生成しようとすると、AIは「キャンバスが広いから、身体を2つ繋げちゃおう」とか「胴体を伸ばして埋めよう」と判断してしまうのです。

これを防ぐための正解ルートは以下の通りです。

- まずは512×512(または512×768などの学習推奨サイズ)で生成する。

- 構図やポーズが破綻していないか確認する。

- 気に入った画像ができたら、「Hires.fix(高解像度化)」機能を使って拡大する。

Hires.fixを使えば、構図を保ったまま、書き込み量を増やして高画質にしてくれます。最初から大きく生成するのではなく、「小さく生んで大きく育てる」のが、奇形を防ぐ鉄則です。

Stable Diffusion分割生成で高画質と整合性を両立

さらに高解像度を目指す場合や、背景まで緻密に書き込みたい場合は、「Stable Diffusion分割生成」というテクニックが役立ちます。

これは、「Tiled Diffusion」や「Multidiffusion」と呼ばれる拡張機能を使用する方法です。

通常、非常に大きな画像を生成しようとするとVRAM(ビデオメモリ)が不足してエラーになったり、画面全体に顔がいくつも現れるようなカオスな状態になったりします。

しかし、分割生成を使うと、AIは画像を小さなタイル状に分割して、それぞれを順番に描いてから最後に合体させます。これにより、メモリの消費を抑えつつ、細部まで奇形防止された巨大な画像を生成できるようになります。

特に、全身画で顔が崩れてしまう問題(全身を映すと顔の解像度が足りなくなる現象)には、この分割生成と「ADetailer」という拡張機能を組み合わせるのが最強の解決策となります。

Stable Diffusion奇形防止LoRAの効果的な使い方

「LoRA(ローラ)」というと、特定のキャラクターや画風を再現するためのものというイメージが強いかもしれません。

しかし、最近ではStable Diffusion 奇形 防止 LoRAとして使える、調整用のLoRAも多く配布されています。

例えば、スライダーを動かすだけで「手の描写」を補正してくれるLoRAや、余計なノイズを減らして線を綺麗にしてくれるLoRAなどがあります。

また、「ControlNet」という技術も併用すると強力です。ControlNetの「OpenPose」を使えば、棒人間でポーズを指定できるため、ありえない関節の曲がり方や、手足の位置がおかしくなることを物理的に防ぐことができます。

ただ、LoRAやControlNetは設定項目が多く、数値の調整がシビアです。入れすぎると画風が壊れてしまいますし、弱すぎると効果が出ません。このあたりの「さじ加減」を掴むのが、脱初心者への第一歩と言えるでしょう。

生成AIスクールでプロレベルの技術を学ぶ

ここまで様々なテクニックを紹介してきましたが、「覚えることが多すぎて大変そう…」と感じた方もいるかもしれません。

実際、Stable Diffusionは奥が深く、独学ですべてのエラーや設定項目を理解するには膨大な時間がかかります。ネット上の情報は古くなっていることも多く、せっかく試したのに上手くいかないことも日常茶飯事です。

もしあなたが、趣味の範囲を超えて、「仕事で使えるレベルの画像を生成したい」「生成AIを副業にしたい」と考えているなら、プロから体系的に学ぶのも一つの近道です。

例えば、「バイテック生成AIスクール」のような専門スクールでは、単にツールの使い方を教えるだけでなく、実務で通用するクオリティを出すためのノウハウが学べます。

特に、今回解説したようなStable Diffusion奇形防止の細かいパラメータ調整や、ControlNetを使った精密な画像生成は、独学だと壁にぶつかりやすい部分です。

バイテック生成AIスクールは、実際にクラウドソーシングなどで案件を獲得することをゴールにした「実践型」のカリキュラムが特徴です。奇形のない美しい画像を作る技術はもちろん、それをどうやって収益化するかという「出口」までサポートしてくれる環境は、独学では得られない大きなメリットです。

まずは自分で試行錯誤してみるのも大切ですが、「最短ルートでプロの技術を身につけたい」という方は、こうしたスクールの活用も検討してみると良いでしょう。確実なスキルがあれば、AIイラストの世界はもっと自由に、もっと楽しくなります。

AIを使って副業を始めたいけれど、「独学だと挫折しそう」「本当に案件が取れるか不安」という方は、実務と収益化に特化したスクールを検討してみるのも近道です。

\ ※完全オンライン・スマホで1分で予約完了 /

実際に、未経験から月5万円の収益化を目指せるバイテック生成AIというスクールについて、評判やカリキュラムの実態を詳しく検証してみました。

▼続きはこちらの記事で解説しています

Stable Diffusion奇形防止 まとめ

今回は、Stable Diffusionで綺麗な画像を生成するための奇形防止テクニックについて解説しました。

最初は失敗ばかりでも、一つひとつの設定を見直していけば、必ず思い通りの画像が作れるようになります。

最後に、今回のポイントをまとめます。

- 奇形防止の基本は「ネガティブプロンプト」を適切に入力することである

- 「bad anatomy」や「worst quality」などの呪文は必須である

- Embedding(EasyNegative等)を使えば、手軽に品質を底上げできる

- ポジティブプロンプトに「masterpiece」等を入れるのも効果的だ

- 胴長になる最大の原因は、初期生成サイズが大きすぎることだ

- 基本サイズ(512×512等)で生成し、Hires.fixで拡大するのが鉄則である

- 分割生成(Tiled Diffusion)は、高画質化と破綻防止に役立つ

- 全身画の顔崩れにはADetailerなどの拡張機能も併用すべきだ

- 奇形防止や手足の修正に特化したLoRAを活用するのも手である

- ControlNetを使えば、ポーズを指定して物理的な崩れを防げる

- パラメータ調整はシビアであり、慣れと経験が必要である

- 独学が難しい場合は、バイテック生成AIスクール等の活用も検討する

- プロから学ぶことで、実務レベルのスキルへ最短で到達できる

- ツールは日々進化しているため、最新情報のキャッチアップが重要だ

- 焦らず設定を一つずつ試すことが、理想の画像への近道である

参考文献・引用データ

- モデルの仕様と制限事項に関する一次情報

stable-diffusion-v1-5/stable-diffusion-v1-5

※世界で最も利用されているモデル「SD1.5」の公式ドキュメント。AIが苦手とする描写やバイアス、技術的な制限事項(解像度による崩れなど)について記述されています。 - 姿勢制御技術「ControlNet」に関する学術論文

Adding Conditional Control to Text-to-Image Diffusion Models (arXiv)

※記事内で解説した「ControlNet」の技術的根拠となる原著論文(コーネル大学運営 arXiv)。ポーズ指定による生成精度の向上について、開発者による技術証明がなされています。 - 生成AI開発元の公式発表

Stability AI Official Website

※Stable Diffusionの開発元であるStability AI社の公式サイト。最新モデルのリリース情報や、画像生成技術のアップデート情報を発信している一次情報源です。

.jpg)