「せっかくいい画像ができそうだったのに、最後の最後でエラーが出た…」

Stable Diffusionを楽しんでいると、誰もが一度はぶつかる壁、それがVRAM不足です。

画面に表示される「CUDA out of memory」という文字を見て、がっくりした経験はありませんか?

私も始めたばかりの頃は、このエラーが出るたびにパソコンの再起動を繰り返して、本当に困り果てていました。

ただ、この問題はパソコンを買い替えなくても、設定を見直したり、ちょっとした工夫をするだけで解決できることが多いんです。

この記事では、今ある環境で最大限に画像生成を楽しむための具体的な方法を、専門用語少なめで優しく解説していきますね。

焦らずに、一つずつ試していきましょう。

この記事を読むと、以下の4点について理解できます。

- VRAM不足を解消するための具体的な設定やコマンドライン引数

- 今使っているグラフィックボード(8GB〜24GB)での最適な運用方法

- 「xformers」や「Tiled VAE」など、メモリを節約する必須テクニック

- 画像生成AIを趣味で終わらせず、仕事にするためのスキルアップ方法

Stable DiffusionのVRAMが足りないエラーの対策と設定

まずは、今すぐにできる対策から見ていきましょう。

「VRAMが足りない」といっても、実は無駄にメモリを消費してしまっているケースが意外と多いんです。

ここでは、設定ファイルを少し書き換えるだけで劇的に改善する魔法のような方法や、生成時のちょっとしたコツを紹介します。

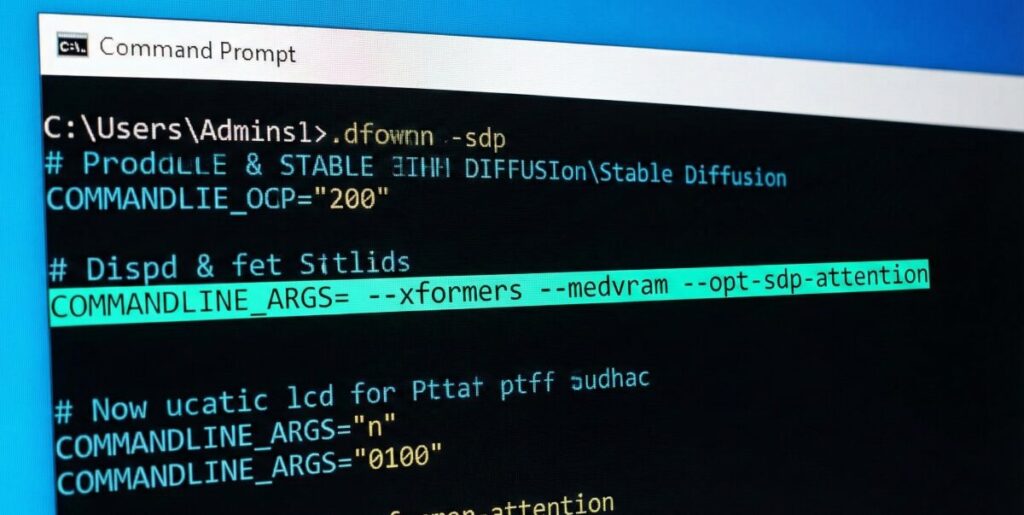

コマンドライン引数でのVRAM設定と節約術

一番効果が高くて、最初に試してほしいのが「コマンドライン引数」の設定です。

難しそうに聞こえるかもしれませんが、やることは「webui-user.bat」というファイルを右クリックして、メモ帳で少し書き足すだけなので安心してください。

具体的には、set COMMANDLINE_ARGS=という部分に、以下の呪文を追加します。

| コマンド | 効果 | おすすめ度 |

| –xformers | 画像生成の速度を上げつつ、VRAM使用量を大幅に減らします。 | ★★★★★ (必須) |

| –medvram | 生成速度は少し落ちますが、VRAM消費をかなり抑えられます。 | ★★★★ |

| –lowvram | 速度は大きく落ちますが、VRAM 4GB〜6GBでも動くようになります。 | ★★★ |

| –opt-sdp-attention | xformersと同じような効果があり、環境によってはこっちの方が速いことも。 | ★★★★ |

もしあなたがRTX 3000番台や4000番台を使っているなら、まずは–xformersか–opt-sdp-attentionを入れてみてください。

これを入れるだけで、今までエラーで止まっていたサイズがあっさり生成できるようになることがよくあります。

古いグラボを使っている場合は、–medvramが救世主になるはずです。

メモリ不足対策の基本は画像サイズとBatch size

設定を変えてもまだエラーが出る場合、単純に「欲張りすぎ」ているかもしれません。

Stable Diffusionでは、生成する画像のサイズ(解像度)を大きくすればするほど、加速度的にVRAMを消費します。

例えば、最初から「1024×1024」のような大きなサイズで生成していませんか?

メモリ不足対策の基本は、「小さく作って、後で大きくする」ことです。

まずは「512×512」や「512×768」で生成して、気に入った画像だけを「Hires. fix(高解像度化)」機能を使って大きくするのが賢いやり方です。

また、「Batch size(一度に生成する枚数)」を増やしすぎていないかも確認してください。

これを「1」にするだけで、VRAMの負担はガクッと下がります。

時間はかかりますが、エラーで止まるよりはずっと良いですよね。

解像度が高いならTiled VAEを活用

「Hires. fix」を使っても、拡大する瞬間にエラー落ちしてしまう…。

そんな時に使ってほしいのが、「Tiled VAE」という拡張機能です。

これは、画像の処理を小さなタイル状に分割して、少しずつ順番に行う技術です。

これを使うと、VRAMの消費量を最小限に抑えながら、驚くほど高解像度な画像を処理できるようになります。

導入方法は簡単で、「Extensions」タブから「Multidiffusion Upscaler for Automatic1111」をインストールするだけ。

設定画面で「Enable Tiled VAE」にチェックを入れれば、今までVRAM不足で諦めていた4Kレベルの画像生成も夢ではなくなりますよ。

こまめなメモリ解放とブラウザ管理

意外と見落としがちなのが、Stable Diffusion以外のアプリによるVRAM消費です。

特にGoogle ChromeなどのブラウザでYouTubeや動画サイトを開きっぱなしにしていると、それだけでVRAMを数GB使っていることがあります。

画像生成をするときは、不要なブラウザのタブや動画プレイヤーを閉じるのが鉄則です。

また、Stable Diffusionを長時間起動し続けていると、徐々にメモリが解放されずに溜まっていくことがあります。

動作が重くなったりエラーが出始めたら、一度黒い画面(コマンドプロンプト)ごと閉じて、再起動してメモリ解放をしてあげましょう。

これだけであっさり解決することも多いですよ。

Stable Diffusionに必要なVRAM容量と足りない場合の考え方

ここまではソフト側での対策をお話ししましたが、やはりハードウェア(グラフィックボード)の性能も重要です。

これからPCを買い替えたり、グラボを交換しようと考えている方のために、VRAM容量ごとの使い心地を、私の体感ベースで正直にお伝えしますね。

Stable Diffusion VRAM 8GBでの運用限界

まず、現在のエントリークラスと言えるVRAM 8GBについてです。

結論から言うと、「工夫すれば遊べるけれど、最新モデル(SDXLなど)はちょっと厳しい」というレベルです。

標準的なSD1.5モデルであれば、先ほど紹介した–medvramなどを駆使すれば問題なく生成できます。

ただ、学習(LoRA作成など)をしようと思うと、かなり厳しいのが現実です。

「とりあえずAIイラストを触ってみたい」という入門用としてはOKですが、本格的にやり込むなら、すぐに物足りなさを感じるかもしれません。

コスパ最強の12GBと余裕の16GB

現在、Stable Diffusionユーザーの間で「標準」と言われているのがVRAM 12GBです。

RTX 3060や4070などがこれに当たります。

12GBあれば、通常の画像生成で困ることはほとんどありませんし、SDXLのような重いモデルも扱えます。

Stable Diffusion VRAM 12GBは、価格と性能のバランスが一番良い選択肢と言えるでしょう。

さらに上を目指すなら、Stable Diffusion VRAM 16GB(RTX 4060 Ti 16GB版や4080など)がおすすめです。

ここまでくれば、複数のControlNetを同時に使ったり、少し凝った学習をさせたりしても余裕があります。

ストレスなく創作活動に没頭したいなら、このラインを目指すと幸せになれます。

本気でやるならVRAM 24GBを目指すべきか

最後に、最強クラスのStable Diffusion VRAM 24GB(RTX 3090 / 4090)です。

「そんなに要るの?」と思うかもしれませんが、本気でAIを研究したり、商用レベルの作品を作ったり、大規模な学習をさせるなら、24GBは決して無駄ではありません。

VRAM残量を気にせず、好きなだけ拡張機能を盛り込める快適さは、一度味わうと戻れません。

ただ、当然ながら価格は非常に高いです。

ここで少し考えてみてほしいのですが、もし高価な機材を導入するなら、それを「趣味」だけで終わらせるのはもったいないと思いませんか?

もしあなたが、

「ハイスペックなPCへの投資を回収したい」

「生成した画像で副業やフリーランスを目指したい」

と考えているなら、『バイテック生成AIスクール』のような場所で、実践的なスキルを学ぶのも一つの手です。

バイテック生成AIスクールは、単に画像の出し方を教えるだけでなく、「実務活用」と「収益化」に特化しているのが特徴です。

LP制作や広告バナーなど、企業が求めるレベルのアウトプットをControlNetなどを駆使して作る技術が学べます。

さらに、案件獲得のサポートまでしてくれるので、VRAM 24GBのパワーを活かして、仕事としてAIクリエイターへの道を切り開くことができるかもしれません。

道具を揃えるのと同時に、それを使いこなして稼ぐための「腕」も磨いてみてはいかがでしょうか。

AIを使って副業を始めたいけれど、「独学だと挫折しそう」「本当に案件が取れるか不安」という方は、実務と収益化に特化したスクールを検討してみるのも近道です。

\ ※完全オンライン・スマホで1分で予約完了 /

実際に、未経験から月5万円の収益化を目指せるバイテック生成AIというスクールについて、評判やカリキュラムの実態を詳しく検証してみました。

▼続きはこちらの記事で解説しています

Stable Diffusion VRAM 足りない問題のまとめ

- VRAM不足は設定の見直しで改善できることが多い。

--xformersは速度アップとメモリ節約の必須コマンドである。- 古いグラボなら

--medvramを使うと動く可能性がある。 - 画像サイズは小さく作り、Hires. fixで大きくするのが基本である。

- Batch sizeを「1」にすることでVRAM消費を抑えられる。

- 高解像度化にはTiled VAEを使うとエラー落ちしにくい。

- ブラウザや動画サイトを閉じてメモリを確保すべきである。

- 長時間起動したら再起動してメモリ解放を行うと良い。

- VRAM 8GBは工夫が必要だが、入門用としては使える。

- VRAM 12GBはコスパが良く、多くのユーザーにとって最適解である。

- VRAM 16GBあれば、複雑な処理もストレスなく行える。

- VRAM 24GBは学習や商用利用を見据えたハイエンド向けである。

- 機材への投資を回収するには、収益化のスキルを学ぶ視点も重要だ。

- バイテック生成AIスクールなら実務レベルの技術が身につく。

- エラーが出ても諦めず、一つずつ設定を試すことが大切だ。

参考資料・公的情報源

本記事の技術的な解説や数値データは、以下の一次情報および公式開発ドキュメントに基づき作成されています。

- VRAM設定およびコマンドライン引数の公式仕様について

記事内で紹介した--medvramや--xformersなどの動作仕様は、公式Wikiの最適化ガイドラインに準拠しています。- AUTOMATIC1111 Stable Diffusion WebUI Official Wiki – Optimizations

- (出典:Stable Diffusion WebUI 公式開発ドキュメント)

- GPUスペックおよびVRAM容量の仕様について

RTX 40シリーズおよび30シリーズのVRAM搭載量などのハードウェア仕様は、NVIDIAの公式データに基づきます。- NVIDIA GeForce RTX 40 シリーズ ファミリー(公式スペック)

- (出典:NVIDIA 公式ウェブサイト)

- メモリ効率化技術(xformers)の技術的根拠について

メモリ消費量を削減する技術「xformers」および「Memory Efficient Attention」は、Meta Research(旧Facebook Research)等の技術基盤を参照しています。- Facebook Research – xformers (GitHub Repository)

- (出典:Meta Research 公式リポジトリ)

.jpg)